Benchmark MMMU: ranking de modelos multimodales en comprensión visual (2026)

- 29 ene

- 3 Min. de lectura

Actualizado: 27 mar

¿Alguna vez te has preguntado qué modelo de IA es mejor entendiendo imágenes?

El benchmark MMMU es una de las mejores pruebas que tenemos para medirlo. Y su versión más exigente, MMMU-Pro, es especialmente útil para comparar modelos punteros.

Mide la capacidad multimodal en preguntas reales, complejas y de nivel experto: de esas que incluyen diagramas, tablas, gráficos y capturas de pantalla.

¿Por qué debería importarte?

Esto no es una prueba de «poner un pie de foto a una imagen». Es un benchmark de razonamiento.

En IA multimodal, es uno de los mejores indicadores indirectos que tenemos de:

comprensión visual en la que puedes confiar

combinar correctamente texto + imagen

resolver problemas reales con diagramas

menos respuestas erróneas dadas con seguridad

Así que, si tu trabajo incluye informes, documentación de ingeniería, pruebas médicas o material visual técnico, las puntuaciones de MMMU/MMMU-Pro importan de verdad.

¿No tienes claro qué modelo escoger?

Consulta nuestra guía completa sobre los mejores LLM

Mejor LLM en el benchmark MMMU-Pro (clasificación)

El benchmark MMMU-Pro muestra algo importante:

El razonamiento multimodal está mejorando rápido…

Pero todavía no está “resuelto”.

La élite se está ajustando

GPT-5.4 y Gemini 3 Pro comparten ahora el primer puesto con un 81 %.

Ese empate importa. Sugiere que los modelos punteros están empezando a converger hacia un rendimiento similar en razonamiento visual.

Justo detrás están Qwen 3 con un 77 %, seguido de Claude Opus 4.6 con un 74 %.

A este nivel, la pregunta ya no es «¿puede el modelo entender imágenes?».

Pasa a ser:

¿Con qué consistencia puede razonar sobre elementos visuales complejos como diagramas, gráficos y documentos técnicos?

El nivel intermedio cae rápido

Por debajo de los líderes, el rendimiento desciende de forma apreciable.

Ernie 5.0 se queda en un 65 %

Grok 4 obtiene un 63 %

Llama 4 Maverick entra con un 62 %

Estos modelos pueden abordar muchas tareas multimodales, pero tienden a fallar con más frecuencia en los problemas de razonamiento visual más difíciles.

En flujos de trabajo que dependen mucho de diagramas, capturas de pantalla técnicas o documentos estructurados, esa brecha se nota mucho.

Mistral se queda atrás

Mistral obtiene un 56 %.

Eso lo sitúa muy por detrás de los modelos punteros.

La visión sigue siendo una capacidad en la que solo compiten los mejores modelos.

¿Qué es el benchmark MMMU?

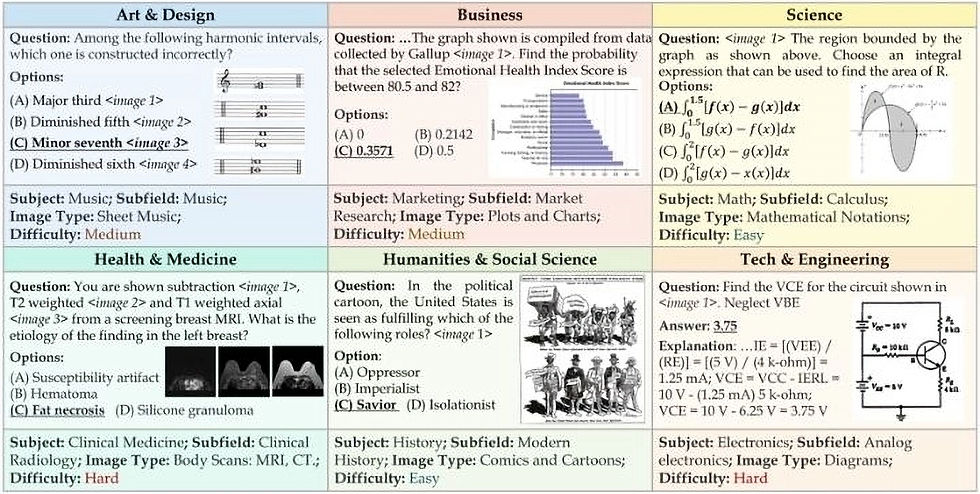

MMMU significa Massive Multi-discipline Multimodal Understanding and Reasoning.

Yue y colaboradores (2024) lo presentaron para evaluar modelos multimodales en tareas de nivel experto que integran texto e imágenes.

El benchmark incluye 11,5K preguntas de nivel universitario extraídas de:

exámenes

cuestionarios

libros de texto

Y cubre seis disciplinas:

arte y diseño

empresa

ciencias

salud y medicina

humanidades y ciencias sociales

tecnología e ingeniería

A diferencia de pruebas de visión más simples, MMMU se centra en el razonamiento profundo, no solo en la percepción.

¿Qué es el benchmark MMMU-Pro?

MMMU-Pro es la versión mejorada.

Se introdujo para hacer el benchmark más difícil y más realista.

La idea clave:

Así que MMMU-Pro añade escenarios visuales más exigentes.

Por ejemplo:

fondos con ruido

formatos del mundo real

preguntas más difíciles, con estilo de documento

Los modelos modernos empezaban a “saturar” MMMU.

Se parece más a lo que la IA multimodal se encuentra en entornos de empresa y de investigación.

MMMU-Pro es ahora uno de los mejores benchmarks que quedan para medir el razonamiento visual de verdad.

¿Listo para aplicar la IA a tu trabajo?

Los benchmarks son útiles, pero el impacto real en el negocio depende de la ejecución.

Impartimos talleres prácticos de IA y desarrollamos soluciones de IA a medida, rápidamente.

Comentarios